数据治理中台是企业数据管理的重要支柱,其数据处理环节承担着将原始数据转化为高质量、可信任数据资产的核心作用。它通过标准化的流程和技术手段,确保数据在企业内部流动的一致性、安全性和可用性。以下将从定义、关键流程和技术工具三个方面展开详细讲解。

一、数据处理的定义与重要性

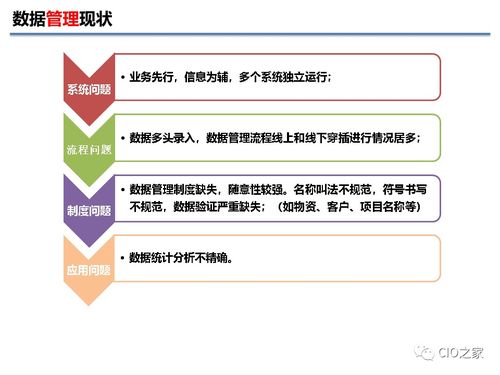

数据处理是数据治理中台的核心环节,指对采集到的原始数据进行清洗、转换、整合和加工,最终形成符合业务需求的规范数据。它不仅是数据治理的基础,更是提升数据价值、支持智能决策的关键。通过高效的数据处理,企业能够消除数据孤岛,减少冗余,提高数据质量,从而为业务应用和数据分析提供可靠支撑。

二、数据处理的关键流程

数据处理通常包括以下标准化流程:

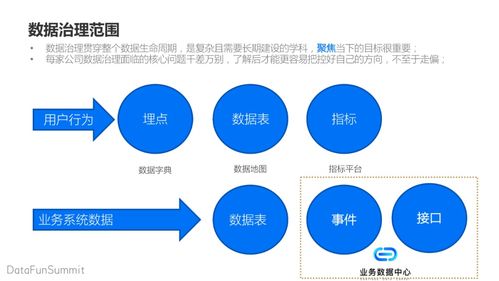

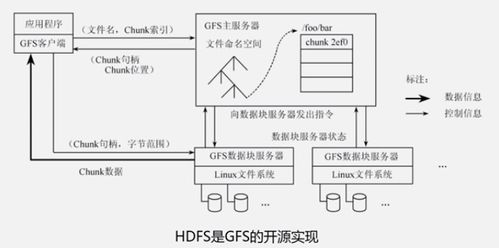

- 数据采集与接入:从多源系统(如数据库、API、日志文件等)中提取数据,并接入中台统一管理。

- 数据清洗与标准化:识别并修正数据中的错误、缺失或重复问题,同时统一数据格式(如日期、单位等),确保数据一致性。

- 数据转换与整合:将异构数据转换为统一模型,并进行关联整合,形成主题域数据(如客户、产品主题)。

- 数据质量监控:通过规则引擎实时检测数据质量,例如完整性、准确性校验,并生成质量报告。

- 数据存储与分类:将处理后的数据分层存储(如原始层、明细层、汇总层),并打上元数据和标签,便于后续使用。

- 数据服务化输出:通过API或数据服务将处理好的数据提供给业务系统、分析平台或前端应用。

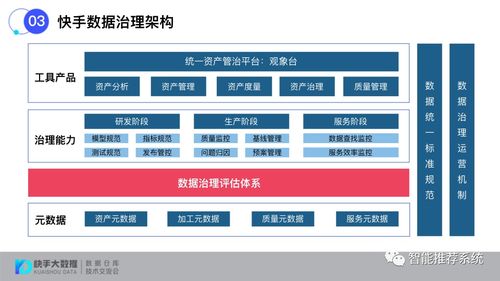

三、数据处理的技术与工具支撑

现代数据治理中台多采用自动化与智能化技术提升处理效率。常用工具包括:

- ETL/ELT工具(如Apache NiFi、Talend):用于数据抽取、转换和加载。

- 数据质量工具(如Great Expectations、Apache Griffin):实现数据校验与监控。

- 实时处理框架(如Apache Kafka、Flink):支持流式数据的即时处理。

- 数据目录与元管理系统:帮助追踪数据血缘和处理历史。

数据处理在数据治理中台中扮演着承上启下的角色。它不仅保证了数据的可信度和可用性,还通过标准化流程降低了数据管理的复杂度。企业应结合自身业务需求,合理设计数据处理架构,并借助自动化工具持续优化,从而充分释放数据价值,驱动数字化转型。